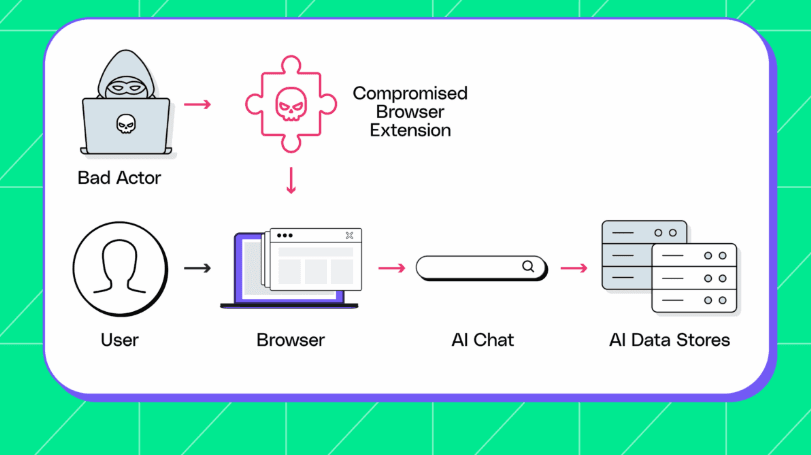

Um novo método de ciberataque está circulando por aí, e o alvo da vez são os usuários de chatbots com inteligência artificial. Conhecida como “Man in the Prompt”, a estratégia usa extensões maliciosas instaladas no navegador para injetar comandos ocultos em interações com IAs como ChatGPT, Gemini, Copilot e Claude.

O ataque explora a estrutura da interface dos chatbots, o nível de privilégios concedido a extensões do navegador e a confiança dos usuários nessas ferramentas. Com isso, os cibercriminosos conseguem inserir comandos ocultos nos prompts enviados à IA e extrair informações sensíveis das respostas fornecidas.

Como acontece o ataque “Man in the Prompt”?

Segundo a empresa de segurança cibernética LayerX, o funcionamento do ataque ocorre da seguinte forma:

- O navegador da vítima é infectado com uma extensão maliciosa;

- Essa extensão possui permissões para acessar o conteúdo das páginas carregadas (área conhecida como Document Object Model, ou DOM);

- O malware é capaz de interceptar e alterar os prompts enviados a chatbots populares;

- Também consegue extrair as respostas exibidas na tela, mesmo quando essas respostas deveriam estar restritas ao usuário.

A técnica é inofensiva em situações simples, como tirar dúvidas rápidas ou revisar conteúdos genéricos. No entanto, o cenário muda completamente no ambiente corporativo, onde chatbots são usados como ferramentas auxiliares em tarefas sensíveis e estratégicas. É nesse contexto que o “Man in the Prompt” representa uma ameaça significativa.

Vulnerabilidade importante para empresas que usam IA

No meio empresarial, as IAs podem acessar dados confidenciais, documentos restritos e processos internos. Por meio da exploração, hackers podem capturar essas informações e utilizá-las para espionagem ou outros tipos de ataques direcionados, aproveitando a confiança do usuário e a integração dos modelos de linguagem à rotina de trabalho.

“O exploit foi testado em todos os LLMs comerciais, com provas de conceito demonstradas no ChatGPT e no Gemini”, afirmou a LayerX. “A implicação para as organizações é que, à medida que se tornam mais dependentes de ferramentas de IA, esses LLMs, especialmente os treinados com dados sensíveis, podem se tornar verdadeiros copilotos de hackers na extração de informações corporativas sigilosas.”

A recomendação da LayerX é revisar as políticas de monitoramento de atividade no navegador. Extensões com permissões amplas devem ser observadas com atenção. Além disso, assim como qualquer software, extensões devem ser avaliadas e aprovadas pela equipe de TI, principalmente em ambientes de trabalho.

Quer saber como se proteger de novas ameaças digitais envolvendo inteligência artificial? Siga o TecMundo nas redes sociais e fique por dentro de tudo sobre segurança cibernética e tecnologia.